Conmoción del tanque. El Pentágono tiene la intención de dotar a los vehículos blindados de inteligencia artificial

ATLAS contradictorio

A principios del año pasado, el ejército de Estados Unidos alarmó al mundo noticias sobre el desarrollo del sistema ATLAS (Advanced Targeting and Lethality Aided System), diseñado para llevar las operaciones de combate a un nuevo nivel de automatización. La iniciativa provocó una reacción mixta entre la gente común y los expertos militares ilustrados. Gran parte de la culpa recayó en los desarrolladores (el centro militar C5ISR y el Centro de Armas del Ministerio de Defensa), quienes, en aras de la eufónica abreviatura ATLAS, incluyeron los términos "letalidad" y "designación de objetivo mejorada" en el nombre. Asustado cuentos sobre los rebeldes robots, los estadounidenses criticaron la empresa del ejército, dicen, contradice la ética de la guerra. En particular, muchos se refirieron a la Directiva del Pentágono 3000.09, que prohíbe transferir el derecho a abrir fuego a un sistema automatizado. La integración de la inteligencia artificial y el aprendizaje automático en la tecnología terrestre, según los manifestantes, puede provocar bajas repentinas entre la población civil y las tropas amigas. Entre los críticos se encontraban científicos bastante respetables, por ejemplo, Stuart Russell, profesor de informática en la Universidad de California en Berkeley.

Clásico tanques obsoleto y requiere una automatización temprana, según el ejército de EE. UU. Fuente: htstatic.imgsmail.ru

Los desarrolladores explicaron razonablemente que ATLAS no tiene nada que ver con los hipotéticos "robots asesinos" con los que la humanidad ha estado soñando desde el primer "Terminator". El sistema se basa en algoritmos de búsqueda de objetivos utilizando varios sistemas de sensores, seleccionando los más importantes e informando al operador sobre ellos. Ahora, en los EE. UU., Se está probando el vehículo blindado de transporte de personal M113 con el sistema ATLAS integrado. Para el operador del arma, los algoritmos de inteligencia artificial muestran no solo los objetivos más peligrosos en la pantalla, sino que también recomiendan el tipo de munición e incluso la cantidad de disparos para una derrota garantizada. Según los desarrolladores, la decisión final sobre dar en el blanco sigue siendo del tirador, y es él quien es responsable del resultado. La tarea principal de ATLAS en una versión blindada es aumentar la velocidad de respuesta a una amenaza potencial: en promedio, un tanque (BMP o transporte de personal blindado) abre fuego contra un objetivo con un asistente automático tres veces más rápido. Naturalmente, un vehículo blindado puede funcionar de manera más eficaz con objetivos grupales. En este caso, la inteligencia artificial selecciona rápidamente los objetivos en el orden de peligro del tanque, guía el arma por sí sola y recomienda el tipo de munición. Desde principios de agosto, en el campo de pruebas de Aberdeen se han probado varios tipos de vehículos blindados con sistemas ATLAS integrados. Con base en los resultados del trabajo, se tomará una decisión sobre las pruebas militares e incluso sobre la adopción de una similar. armas.

Pruebas de componentes ATLAS en Aberdeen Proving Grounds. La foto muestra el compartimento de aterrizaje M113. Fuente: c4isrnet.com

Los tanques son ahora uno de los objetos más conservadores en el campo de batalla. Muchos de ellos no han mejorado fundamentalmente durante décadas, permaneciendo en los años 70-80 del siglo pasado en términos de desarrollo técnico. A menudo, tal inercia está asociada con el uso generalizado de tanques en países individuales. Para modernizar seriamente el ejército blindado de muchos miles, se requieren enormes recursos. Pero los medios para contrarrestar los tanques se están desarrollando a pasos agigantados. Un excelente ejemplo es el conflicto actual en Nagorno-Karabaj, cuando turcos e israelíes drones extremadamente eficaz contra los tanques armenios. Si ignoramos la pérdida de vidas, el cálculo de la relación precio/efectividad de este tipo de armas antitanque las convierte simplemente en los reyes del campo de batalla. Por supuesto, ATLAS no protegerá contra una amenaza desde el aire, pero puede ser una buena herramienta para la alerta temprana de objetivos que amenazan a los tanques, como las tripulaciones de ATGM o los lanzadores de granadas individuales.

Estos son los objetivos potenciales que consideran los autores del concepto de Proyecto de Convergencia. Fuente: defensenews.com

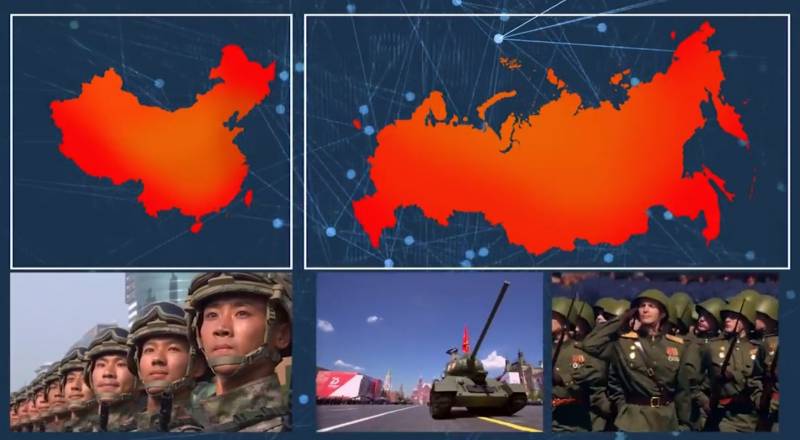

El Pentágono considera el sistema ATLAS no como una estructura militar única, sino como parte de un gran Proyecto de Convergencia. Esta iniciativa debería llevar la conciencia de las tropas al siguiente nivel. A través del aprendizaje automático, la inteligencia artificial y la saturación sin precedentes del campo de batalla con drones, los estadounidenses esperan aumentar seriamente la capacidad de combate de sus unidades. La idea clave no es nueva: conectar todos los objetos en el campo de batalla con una estructura de información común y digitalizar la realidad circundante. Hasta ahora, ATLAS no está completamente incluido en el Proyecto Convergencia debido a la falta de habilidades de intercambio de datos con "vecinos", pero en el futuro, los cerebros artificiales del tanque se convertirán en propiedad común. Por cierto, en el comercial del proyecto, China y Rusia se designan como objetivos militares inequívocos.

Sin confianza en la electrónica

Las tropas estadounidenses ya tienen una experiencia negativa con los sistemas robóticos armados. En 2007, se enviaron a Irak tres plataformas de orugas de pequeño tamaño, SWORDS (abreviatura de Special Weapons Observation Reconnaissance Detection System), armadas con ametralladoras M249. Y aunque no eran vehículos totalmente autónomos, lograron asustar a los soldados con sus periódicos caóticos movimientos de los cañones de las ametralladoras mientras patrullaban las calles de Bagdad. Para el Pentágono, esto parecía una señal de imprevisibilidad, y los artilleros de las ametralladoras con orugas fueron enviados lentamente a casa. En 2012, se emitió una directiva que indica que los sistemas de armas automatizados y controlados a distancia no deben disparar por sí mismos. Formalmente, ATLAS se ha desarrollado íntegramente en el marco de esta disposición, pero no hay menos preguntas sobre la innovación. Algunos expertos (en particular, Michael S. Horowitz, profesor asistente de ciencias políticas en la Universidad de Pennsylvania) acusan la novedad de simplificar demasiado el proceso de dar en el blanco. De hecho, este nivel de automatización de búsqueda y designación de objetivos convierte el combate en un juego ordinario como World of Tanks para el artillero. En el sistema de guía ATLAS, el objetivo prioritario se resalta en rojo, suena una alarma y la técnica, como puede, estimula a una persona a abrir fuego. En condiciones de combate extremas, hay poco tiempo para tomar una decisión sobre disparar, y luego el "robot inteligente" te anima. Como resultado, el luchador simplemente no tiene tiempo para evaluar críticamente la situación y, sin entenderlo, abre fuego. Es necesario evaluar cómo ATLAS seleccionó correctamente los objetivos después de disparar. ¿Hasta qué punto es ético este enfoque y está en consonancia con la notoria directiva estadounidense? Microsoft, por cierto, ya ha logrado caer bajo la condena pública por un sistema de designación de objetivos montado en el casco para los militares, incluido un boicot de usuarios. En los Estados Unidos, ha habido disputas sobre los sistemas robóticos de detección y guía durante muchos años. Como ejemplo, los críticos citan ejemplos de errores del sistema de piloto automático en la vía pública, que ya han provocado víctimas. Si incluso después de conducir millones de kilómetros, los pilotos automáticos no se volvieron 100% confiables, entonces, ¿qué podemos decir acerca de un ATLAS completamente nuevo, que puede empujar a los camiones cisterna a disparar contra una persona inocente con un proyectil de 120 mm? Las guerras modernas son ahora tan sangrientas precisamente porque los militares tuvieron la oportunidad de matar a distancia, escondiéndose detrás de una barrera confiable. El ejemplo del mencionado Nagorno-Karabaj confirma una vez más esta verdad. Si el luchador también se ve privado de la oportunidad de evaluar críticamente los parámetros del objetivo (esto es exactamente a lo que conduce ATLAS), entonces las víctimas pueden llegar a ser mucho más y la culpa del asesinato ya puede ser parcialmente transferida a la máquina.

Y finalmente, el principal argumento en contra de los sistemas tipo ATLAS entre los comentaristas pacifistas fue la virtual ausencia de una prohibición sobre la apertura de fuego automático. Ahora solo los requisitos éticos del Pentágono (que también tienen muchas reservas) prohíben automatizar por completo el proceso de asesinato. Con la introducción de ATLAS, no habrá obstáculos técnicos para esto. ¿Podrá el Ejército de los EE. UU. Renunciar a una oportunidad tan prometedora para acelerar aún más el tiempo de respuesta a una amenaza y evitar que sus soldados sean atacados?

información