La tercera revolución militar: la inteligencia artificial no debe estar armada

La principal tendencia del siglo XXI

A pesar de toda la ambigüedad del término "inteligencia artificial" (en adelante, IA), se han creado durante mucho tiempo todos los requisitos previos para el surgimiento de sistemas de combate altamente productivos y de autoaprendizaje en los ejércitos del mundo.

Si la IA no existiera, aún tendría que inventarse. Ahora, en casi todas las esferas de la vida humana, se genera una cantidad gigantesca de información cada segundo, que simplemente no hay nada que procesar.

Y los asuntos militares están lejos de ser una excepción: basta recordar el conflicto de Nagorno-Karabaj para comprender la verdadera escala del contenido de información de las operaciones militares.

El flujo de datos de foto, video y radar, así como los mensajes de audio y texto, se convierte en la corriente principal del campo. Solo ahora podemos reformular la conocida expresión

en moderno

Y para el procesamiento operativo de "big data" (o big data), se requieren tecnologías muy serias. Como redes neuronales artificiales capaces de autoaprendizaje sin la intervención del operador. Una ventaja importante de las redes neuronales es la capacidad de identificar patrones basados en datos que no están presentes en el código de entrenamiento original.

Para los militares, la capacidad potencial de la IA para trabajar con datos incompletos, "ruidosos" o distorsionados es de particular importancia. Es por eso que las redes neuronales de aprendizaje profundo ahora están esperando a la vista los sistemas de inteligencia para analizar rápidamente materiales de video y fotografía. Como se señaló en los departamentos militares, las tareas que tomaron meses de trabajo de decenas de decodificadores pueden ser resueltas por IA en segundos.

Sin embargo, un simple análisis de conjuntos de datos incluso ahora parece insuficiente para las operaciones militares: requiere

и

objetivo potencial.

Sobre la base de estas "conclusiones", el operador tomará la decisión de abrir fuego. Esto acelerará seriamente el curso de las operaciones ofensivas.

Por ejemplo, hace unos años, durante la Operación Libertad Duradera, el dron MQ-1 Predator entró en un convoy de equipo enemigo. Pero mientras el operador evaluaba la afiliación y decidía lanzar el cohete, el equipo abandonó la zona afectada. Y este está lejos de ser el único ejemplo.

El uso de IA en este caso permitiría hacer rápidamente un pronóstico sobre las perspectivas y el momento del ataque. Pero también hay trampas aquí.

El Comité de la Cruz Roja está seriamente preocupado por la introducción de la IA en los vehículos no tripulados y (lo más importante) el nivel de confianza humana en ella. Por ejemplo, ¿se puede identificar de manera confiable a una persona que excava cerca de una carretera como operador de un dispositivo explosivo improvisado basándose únicamente en el análisis de la señal de video mediante redes neuronales?

Ahora operadores de tambor drones muy a menudo no se dan cuenta de la realidad de lo que está sucediendo en el campo de batalla (mentalidad de Playstation). ¿Y si la IA los ayuda con esto?

La tarea de destrucción ya notablemente simplificada será aún más fácil de ejecutar.

¡Automatizarlo!

Los desafíos tecnológicos y estratégicos están obligando a las potencias mundiales a trasladar gradualmente sus ejércitos a los rieles de la robótica.

Por ejemplo, en Estados Unidos, la "Tercera Estrategia Compensatoria" promete convertir a las fuerzas armadas en un ejército. robots ya treinta años después. Y en diez años, uno de cada tres aviones del Pentágono no estará tripulado.

Rusia también está tratando de mantenerse al día. Y en los próximos años, planean aceptar en el ejército varias docenas de nuevos tipos de armas controladas a distancia. Sin embargo, ni Estados Unidos ni Rusia todavía carecen de sistemas completos de reconocimiento y ataque controlados por IA. Esto se debe en gran parte a la crisis de responsabilidad. Si los errores del primer tipo, es decir, los ataques incorrectamente cancelados al enemigo, aún pueden ser soportados de alguna manera, entonces con los errores del segundo tipo todo es mucho más complicado. En el último caso, el vehículo decide hacer "fuego amigo" o destruye civiles, es decir, comete un crimen de guerra.

En esta situación, no está completamente claro quién es el responsable de tal acto: el desarrollador de software o el comandante que dio la orden de usar el sistema.

Una situación similar existe en la industria automotriz, que ha estado soñando con drones totalmente autónomos durante varias décadas. Incluso se desarrolló una clasificación de niveles de automatización, que es bastante aplicable al ámbito militar.

En el nivel cero, el automóvil es un UAZ-496 condicional, en el que todo está bajo el control del conductor y no hay asistentes mecatrónicos: ESP, ABS, etc.

En el quinto nivel más alto, un dron con ruedas incluso carece de volante (o está instalado como una opción paga). Y en todas las situaciones, el movimiento está controlado por el piloto automático. Actualmente, solo la japonesa Honda ha podido certificar un piloto automático en serie de nivel XNUMX.

Esta técnica de "automatización condicional" no es capaz de asumir el control en una situación peligrosa. Y en condiciones normales no siempre funciona. El sistema Traffic Jam Pilot pilota automáticamente el coche en atascos, lo mantiene dentro del carril de la autopista y realiza adelantamientos. Puede quitar las manos del volante, pero no puede apartar la vista de la carretera: las cámaras están mirando. El piloto automático de tercer nivel es muy caro y aumenta el costo total del automóvil en una vez y media.

Debe recordarse que los pilotos automáticos ya se pueden implementar completamente en la producción en masa. Y realmente reducirán seriamente las muertes por accidentes de tránsito. Pero los problemas legales y éticos de los errores (incluidos los fatales) de la IA paralizaron a las empresas de automóviles.

La IA no debería estar armada

En el ámbito militar, la situación con el desarrollo de sistemas de combate totalmente autónomos también está lejos de ser ideal.

Y ni siquiera es el aspecto técnico del problema.

Por un lado, los expertos escépticos señalan la capacidad potencial de los sistemas de autoaprendizaje basados en redes neuronales para realizar ataques preventivos. Por ejemplo, la IA verá una vulnerabilidad real o percibida en el enemigo: ¿por qué no es esta una razón para lanzar el primer ataque de desarme? Además de esto, todos los "cerebros artificiales" son propensos a la competencia y la falta de elementos de pensamiento crítico, lo que tampoco agrega credibilidad por parte de la persona.

Los analistas de la Corporación RAND, en general, instan en ningún caso a confiar las decisiones estratégicas militares a la inteligencia artificial, ni en el presente ni en el futuro. Si bien todavía es posible aguantar a varios no combatientes destruidos por error por la IA, todo será mucho más trágico cuando se aplique a las fuerzas de disuasión nuclear.

No todo es tan sencillo con lo operativo-táctico armas Controlado por IA.

Volvamos a las imágenes de Nagorno-Karabaj, que ilustran claramente la superioridad técnica de los drones de choque sobre las armas tradicionales. Aquí todos entendieron que en el cielo solo había máquinas controladas a distancia, aunque muy perfectas.

¿Cuál sería la reacción del público si las huelgas fueran realizadas por Bayraktar totalmente autónomo?

¿Cuándo viviría la IA para que el mundo entero matara personas, aunque fuera con armas en la mano?

El lado moral del problema aún no se ha resuelto aquí. Y es poco probable que se resuelva en un futuro próximo.

Fuente: mil.ru

En general, los robots del ejército son, por supuesto, buenos.

Te permiten retirar a los soldados del fuego directo del enemigo, transfiriendo todo el trabajo a unidades de combate controladas a distancia. Se reducen las pérdidas y los costes. Y la guerra parece volverse más humana.

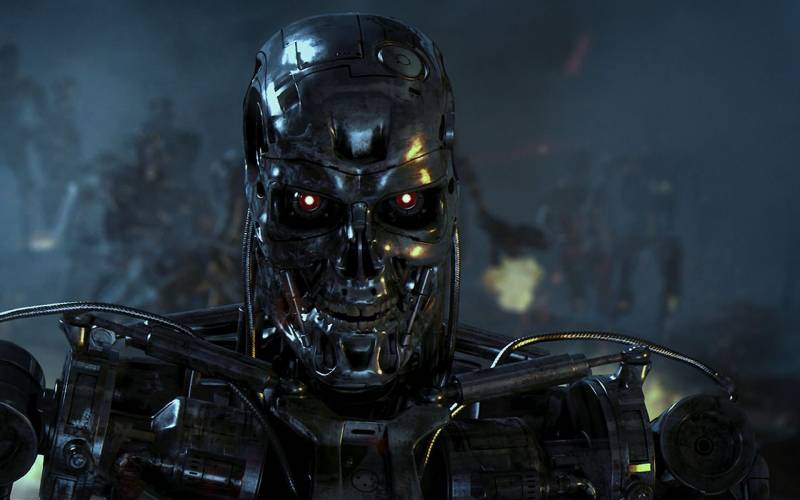

Los robots totalmente autónomos en la esfera militar o el sistema de armas autónomas letales no tienen nada que ver con la humanidad y la reducción de pérdidas. Las redes neuronales de aprendizaje profundo hacen que la guerra sea mucho más rápida y costosa. En realidad, esto es exactamente lo que aseguraron las dos revoluciones militares anteriores en asuntos militares: la pólvora y la nuclear.

Esto es entendido por muchas corporaciones civiles involucradas con el estado en proyectos de defensa.

Entonces, en 2018, Google se retiró del proyecto Maven altamente rentable por un valor de más de $ 7,5 mil millones. Especialistas de Silicon Valley, junto con DARPA, trabajaron en un programa para procesar matrices de información de video y fotos de numerosos servicios de inteligencia. droneless. Los datos fueron procesados por una red neuronal. Y le dio al operador una "biblioteca de objetivos" en orden de prioridad para la destrucción. Google fuera de historias... Y ahora DARPA está tratando de arreglárselas por su cuenta.

Un aspecto importante de la IA en el ejército es su uso en la guerra de información.

Podemos decir con cierto grado de confianza que en un futuro muy cercano, más revelaciones de Rusia y (en mayor medida) China en el desarrollo de una inteligencia artificial de combate simplemente saldrán de los Estados Unidos. Si no es posible convencer al público dentro del país de la necesidad de una mente militar autónoma, entonces asustaremos con enemigos externos. El Pentágono ha sido famoso por esta lógica desde la antigüedad. Dicen que ya están trabajando en IA en su totalidad, y aquí no podemos hacer frente a nuestra propia moralidad.

Y finalmente, las respuestas asimétricas a las amenazas de la IA de combate parecen bastante prometedoras. Hoy en día, las tecnologías para enmascarar objetos del ojo que todo lo ve de la inteligencia artificial e incluso el engaño deliberado están ganando fuerza.

Hasta ahora, la IA funciona bastante bien en condiciones pacíficas, cuando la información se sirve en bandeja de plata.

Es muy difícil funcionar con datos incompletos y ruidosos. Por lo tanto, los intentos de engañar a la inteligencia artificial con datos corregidos deliberadamente parecen bastante lógicos. Cuando el tiempo de respuesta de una IA armada se calcula en segundos y no depende de la opinión de una persona, dicha información errónea puede llevar a consecuencias difíciles de predecir.

Es mejor cancelar la tercera revolución militar, de manera amistosa.

O desarrollar medidas restrictivas conjuntas para el desarrollo y uso de la IA en el ámbito militar. ¿Pudiste hacer algo similar en el caso de las armas nucleares?

información